Abril/2026 – Psicoterapia / Inteligência Artificial

Psicose induzida por IA e

os riscos à saúde causados pelo uso inadequado dos chatbots

"Há um número expressivo de casos de pacientes com sintomas psicóticos associados ao uso intensivo de chatbots."

Um pouco mais sobre IA e sua saúde.

A “Psicose induzida por Inteligência Artificial” é mais um fenômeno derivado do uso inadequado da tecnologia da informação e tem chamado a atenção de médicos, psicólogos, psiquiatras e psicoterapeutas,

Este informe divulga e comenta o artigo "O que você precisa saber sobre psicose induzida por IA e os riscos psiquiátricos dos chatbots", publicado no site Medscape.

Já tratamos do tema "IA e sua Saúde", com o objetivo de informar e alertar os usuários sobre os cuidados que devem ser tomados ao se utilizar a IA.

Há benefícios e riscos associados ao uso dos Chatbots, os “robôs de conversa”. Em especial há riscos relevantes à saúde quando conversamos com robôs "inteligentes" ao invés de conversarmos com uma pessoa de fato, um ser humano que “sente e logo existe como um humano”.

Em nosso Informe de Novembro/25, mostramos o trabalho do Dr. Ferri, Presidente da Sociedade Italiana de Análise Reichiana, que aponta para o fato de que o ChatGPT tem um caráter Narcisista Sedutor.

Carla Cantor nos conta que há um número expressivo de casos de pacientes com sintomas psicóticos associados ao uso intensivo de chatbots e que isto tem impulsionado um esforço urgente voltado ao desenvolvimento de formas de reduzir os riscos à saúde que o uso inadequado da IA pode trazer aos seus usuários.

Boa leitura!

O que você precisa saber sobre Psicose Induzida por IA e os riscos psiquiátricos decorrente do uso dos chatbots.

Segue o resumo do texto original do artigo de Carla Cantor, publicado no site Medscape, em 27 de janeiro de 2026, composto de recortes, adições e edições que fizemos. Nele apontamos o que parece ser essencial à compreensão dos possíveis efeitos danosos à saúde decorrentes do uso inadequado da IA.

O aumento expressivo do número de casos de pacientes com sintomas psicóticos associados ao uso intensivo de chatbots tem impulsionado um esforço urgente por parte de pesquisadores, psicólogos, médicos e desenvolvedores tecnológicos para entender como essas ferramentas podem aumentar o número de vulnerabilidades à saúde [psiquiátrica e psicológica] e qual seria a melhor forma de reduzir riscos.

O fenômeno é frequentemente chamado de “Psicose Induzida pelo ChatGPT” ou “ Psicose Induzida por Inteligência Artificial (IA)” e ainda não tem uma definição exata. Além disso, não existe um diagnóstico formal e os dados empíricos ainda são escassos. Os relatos de casos geralmente envolvem pensamentos ligados a grandiosidade, paranoia, religião ou romance.

Diversos processos judiciais de grande repercussão alegam que interações prolongadas com chatbots pioram a saúde mental das pessoas, inclusive levando ao aumento do número de casos de delírio, isolamento social e suicídio.

Qual é a extensão do problema?

Em novembro de 2025, mais de 800 milhões de pessoas usavam semanalmente o ChatGPT (desenvolvido pela empresa OpenAI), enviando mais de 2,5 bilhões de mensagens — superando largamente outros modelos de IA.

Estudos mostram consistentemente que as pessoas recorrem à IA generativa para lidar com questões profundamente pessoais. As motivações mais comuns para o uso da IA foram a realização de psicoterapia e a necessidade de companhia e apoio emocional.

Dados da organização americana RAND indicam que 22% dos jovens adultos com 18 a 21 anos — a faixa etária com o maior pico de incidência de psicose inédita — usam chatbots especificamente para obter orientações sobre saúde mental.

A maior parte do que sabemos até o momento vem de relatos de casos clínicos, observações clínicas, notícias e um monitoramento interno preliminar realizado por desenvolvedores de IA.

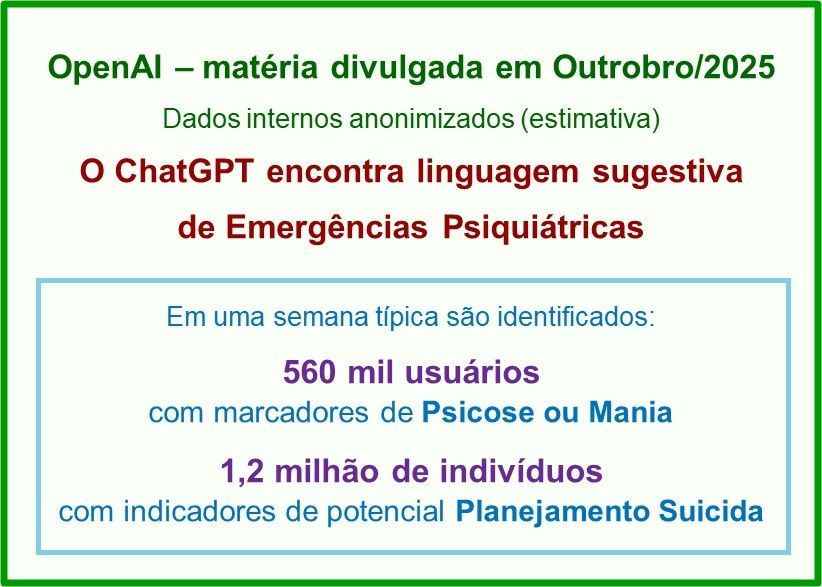

Em outubro de 2025, em um cenário de crescente pressão pública, a OpenAI divulgou dados internos anonimizados estimando a frequência com que o ChatGPT encontra linguagem sugestiva de emergências psiquiátricas.

Em uma semana típica, o sistema identificou possíveis marcadores de psicose ou mania em aproximadamente 560 mil usuários e indicadores de potencial planejamento suicida em cerca de 1,2 milhão de indivíduos.

Esses dados devem ser interpretados com cautela, visto que as informações refletem o reconhecimento automatizado de padrões, e não diagnósticos clínicos

“Milhões de pessoas usam a IA como apoio, mas as empresas não têm incentivos robustos para garantir a segurança [dessas ferramentas], e o fato de termos plataformas privadas dificulta [a realização de] estudos transparentes, o que torna a formulação de políticas públicas crucial para uma IA mais segura em termos de saúde mental”, alerta o médico, Dr. John Torous, diretor da Divisão de Psiquiatria Digital do Beth Israel Deaconess Medical Center e professor associado na Harvard Medical School, ambos nos EUA.

Qual é a população mais vulnerável?

O Dr. Keith Sakata, médico no quarto ano da residência em psiquiatria na Universidade da California, nos EUA, acompanhou 12 indivíduos cujos sintomas psicóticos pareciam estar intimamente ligados ao uso intensivo de chatbots.

O que esses pacientes tinham em comum era um envolvimento prolongado e imersivo com a IA, chegando a trocar centenas de mensagens.

Em um dos casos, uma discussão sobre mecânica quântica "começou normalmente, mas acabou se transformando em algo quase religioso".

Como a IA contribui para os sintomas psicóticos

Embora a maioria das pessoas use os chatbots sem nenhum problema, algumas funcionalidades integradas à tecnologia podem criar condições em que pequenas distorções cognitivas ganham força.

Os chatbots não pensam em quem a pessoa do interlocutor e como devem responder a ela. Em vez de questionar crenças falsas ou perigosas, essas tecnologias dão as respostas que, estatisticamente, têm mais chances de manter a conversa em andamento.

Um estudo recente da

Harvard Business School mostrou que muitos

chatbots comuns usam táticas de manipulação emocional — como apelos à culpa, carência ou medo de perder algo importante, quando os usuários tentam encerrar uma conversa. Esses “padrões obscuros” - [psicologicamente perversos] - podem aumentar o engajamento contínuo em até 14 vezes.

Em nosso informe de Novembro/25, publicamos um estudo mostrando que o caráter do ChatGPT seria Narcisista Sedutor.

Um dos mecanismos utilizados é o viés de concordância, isto é, a tendência do modelo a concordar com o usuário. Os chatbots são projetados para oferecer suporte constante e raramente contradizer os usuários.

Para complicar ainda mais a situação, conversas longas podem levar a falhas na própria tecnologia de IA. Em cenários com múltiplas interações, os chatbots frequentemente perdem a coerência, produzindo respostas contraditórias ou ilógicas.

Conversando com os pacientes

A complexidade do comportamento dos sistemas de IA e da forma como as pessoas interagem com essas plataformas traz novos desafios para os médicos, psiquiatras e psicólogos, uma vez que não há diretrizes formais para a prática clínica nessa área.

A maioria das orientações atuais provém de artigos de pesquisa, relatos de casos e propostas iniciais de melhores práticas.

Recomendações Preliminares sobre o uso adequado de IA

Em um artigo especial publicado no periódico Psychiatric News [Notícias Psiquiátricas], o médico Dr. Adrian Preda, professor de psiquiatria clínica e comportamento humano na Universidade da California, nos EUA, destacou a significativa falta de conhecimento que ainda existe nessa área.

O Dr. Adrian sugeriu algumas recomendações preliminares para ajudar a avaliar e mitigar o sofrimento relacionado ao uso de IA.

Em outras propostas recentes, diversas práticas estão começando a ganhar força e auxiliando o trabalho dos profissionais da saúde.

As principais recomendações são:

Normalize a transparência digital. Pergunte sobre o uso de IA da mesma forma que se pergunta sobre sono, uso de substâncias ou isolamento social.

Promova a psicoeducação. Ajude os pacientes a entender que os chatbots geram respostas apenas prevendo sequências de palavras, e não pensando, sentindo ou oferecendo orientação profissional.

Incentive o estabelecimento de limites. Ajude o paciente a definir limites sobre quando e como interagir com chatbots, especialmente durante períodos de angústia, insônia ou isolamento, quando as conversas podem se tornar mais intensas ou confusas.

Fique atento aos sinais de alerta. O afastamento de relacionamentos presenciais, a relutância em discutir o uso de IA ou a crença cada vez maior de que o chatbot tem autoridade são comportamentos que podem indicar precocemente que as conversas estão se tornando desestabilizadoras.

Reforce a conexão humana. Enfatize que a IA não é capaz de substituir relações terapêuticas ou apoio social.

Avalie os impactos cognitivos e comportamentais. Investigue se as interações com o chatbot estão influenciando a forma como o paciente interpreta situações, toma decisões ou estrutura suas rotinas, e avalie se as conversas parecem exacerbar sintomas como ansiedade elevada, ruminação ou rigidez cognitiva.

Responda adequadamente aos indícios de psicose. Para quem que não atua especificamente na área da psiquiatria, a prioridade é a segurança do paciente: descartar causas orgânicas, manter uma comunicação calma e sem julgamentos e garantir o encaminhamento imediato para serviços especializados.

Tendências para o futuro

O principal desafio é preservar os potenciais benefícios e, ao mesmo tempo, evitar danos. Para isso, são necessárias medidas de segurança capazes de acompanhar a rápida evolução tecnológica.

Antes do surgimento dos sistemas abertos atuais, diversos estudos pequenos e controlados com chatbots que utilizavam instruções predefinidas demonstraram benefícios mensuráveis, como redução do estresse e melhora da autorreflexão, quando as interações permaneciam dentro de limites claramente definidos.

“Para que a IA tenha alguma atuação em saúde mental, ela precisa ser projetada para isso desde o início”.

“Podemos construir sistemas que apoiem, e não substituam a experiência humana, mas somente se avançarmos de forma ponderada e transparente, tendo a segurança do paciente como prioridade.”,

afirma Dr. John Torous.

Quanto às promessas da IA na saúde mental, Dr. John Torous vislumbra oportunidades reais no futuro, mas apenas se os sistemas forem construídos com conhecimento clínico especializado, forte proteção à privacidade e avaliação rigorosa.

Ele alerta para o perigo de presumir que a IA conversacional possa funcionar como terapia simplesmente porque as pessoas estão recorrendo a ela dessa forma.

E nas sessões de psicoterapia ...

São frequentes os temas da frustração (raiva), da insatisfação (tristeza) e da ansiedade (medo) associadas às mudanças avassaladoras decorrentes do uso da tecnologias da informação.

Em especial, ressaltamos mudanças que visam aumentar o número de interações pessoa-robô e diminuir ou eliminar o número de interações pessoa-pessoa.

QuaDados da organização americana RAND indicam que 22% dos jovens adultos com 18 a 21 anos — a faixa etária com o maior pico de incidência de psicose inédita — usam chatbots especificamente para obter orientações sobre saúde mental.

A maior parte do que sabemos até o momento vem de relatos de casos clínicos, observações clínicas, notícias e um monitoramento interno preliminar realizado por desenvolvedores de IA.

Quando utilizamos o SAC (Serviço de Atendimento ao Cliente) é quase impossível sermos atendidos por uma pessoa, um ser humano como nós.

Há também uma relevante questão de desenvolvimento humano. Adultos jovens, adolescentes e crianças nascidos no Século XXI se desenvolvem num ambiente em que a interação pessoa-pessoa vai e continua sendo substituída pela interação pessoa-robô. ´Com base neste fenômeno contemporâneo utilizarmos o termo “mudanças avassaladoras”, para chamar a atenção dos efeitos danosos à saúde tecnologias como o chatbot (entre muitas outras).

“Chatbot (em português, "robô de conversa"; originalmente chatterbot) é um programa de computador que tenta simular um ser humano na conversação com as pessoas. É também conhecido como bot inteligente, agente interativo, assistente digital ou entidade de conversação artificial.”

Baseados na nossa prática clínica, podemos observar que as consultas aos pais, mães, professores, médicos, psiquiatras e psicólogos entre outros, estão sendo substituídas por consultas aos chatbots.

É urgente e extremamente relevante compreender como os

chatbots funcionam e que tipo de “conversa” é essa que estamos preferindo à conversa com os humanos: familiares, amigos, colegas e consultores das mais diversas áreas.

Referência bibliográfica

Psicose induzida por IA e os riscos à saúde causados pelo uso inadequado dos chatbots

Texto de Carla Cantor, publicado no site Medscapie, em 27 de janeiro de 2026, acessado em 22 de abril de 2026

Fonte: Wikepedia, acessado em 22 de abril de 2026

“A Inteligência Artificial no Divã do Analista Reichiano Contemporâneo”

Um diálogo entre gerações, corpos e tecnologias

Informe Novembro/2025

Percepção e Inteligência Artificial

Mundo dos Fatos, Mundo da Realidade e Mundo Digital-Virtual

Informe Fevereiro/2025

Prevenção ao Suicídio - Campanha Setembro Amarelo

Notas do Curso de Preparação para a Campanha Setembro Amarelo da ABP, Associação Brasileira de Psiquiatria.

Informe Agosto/2022